Tres leyes de la robótica - Three Laws of Robotics

| Leyes de la robótica |

|---|

|

Tres leyes de la robótica de Isaac Asimov ( en cultura ) |

| Temas relacionados |

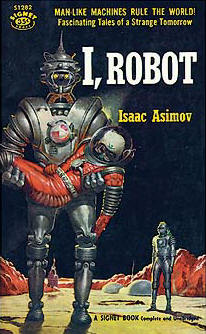

Las Tres Leyes de la Robótica (a menudo abreviadas a Las Tres Leyes o conocidas como Leyes de Asimov ) son un conjunto de reglas ideadas por el autor de ciencia ficción Isaac Asimov . Las reglas fueron introducidas en su cuento de 1942 " Runaround " (incluido en la colección de 1950 I, Robot ), aunque habían sido prefiguradas en algunas historias anteriores. Las Tres Leyes, citadas del "Handbook of Robotics, 56th Edition, 2058 AD", son:

- Primera ley

- Un robot no puede dañar a un ser humano o, por inacción, permitir que un ser humano sufra daños.

- Segunda ley

- Un robot debe obedecer las órdenes que le den los seres humanos, excepto cuando tales órdenes entren en conflicto con la Primera Ley.

- Tercera ley

- Un robot debe proteger su propia existencia siempre que dicha protección no entre en conflicto con la Primera o Segunda Ley.

Estos forman un principio organizador y un tema unificador para la ficción basada en robótica de Asimov , que aparece en su serie Robot , las historias vinculadas a ella y su serie Lucky Starr de ficción para adultos jóvenes . Las Leyes están incorporadas en casi todos los robots positrónicos que aparecen en su ficción y no se pueden eludir, ya que están pensadas como una característica de seguridad. Muchas de las historias centradas en robots de Asimov involucran a robots que se comportan de maneras inusuales y contrarias a la intuición como una consecuencia involuntaria de cómo el robot aplica las Tres Leyes a la situación en la que se encuentra. Otros autores que trabajan en el universo ficticio de Asimov los han adoptado y las referencias, a menudo paródicas , aparecen tanto en la ciencia ficción como en otros géneros.

Las leyes originales han sido modificadas y desarrolladas por Asimov y otros autores. El propio Asimov hizo ligeras modificaciones a los tres primeros en varios libros e historias cortas para desarrollar aún más cómo los robots interactuarían con los humanos y entre ellos. En la ficción posterior donde los robots habían asumido la responsabilidad del gobierno de planetas enteros y civilizaciones humanas, Asimov también agregó una cuarta, o ley cero, para preceder a las demás:

- Ley Cero

- Un robot no puede dañar a la humanidad o, por inacción, permitir que la humanidad sufra daños.

Las Tres Leyes, y el cero, han impregnado la ciencia ficción y se mencionan en muchos libros, películas y otros medios. También han impactado el pensamiento sobre la ética de la inteligencia artificial .

Historia

En El resto de los robots , publicado en 1964, Isaac Asimov señaló que cuando comenzó a escribir en 1940 sintió que "una de las tramas comunes de la ciencia ficción era ... los robots fueron creados y destruyeron a su creador. El conocimiento tiene sus peligros, sí, pero ¿la respuesta debe ser un alejamiento del conocimiento? ¿O el conocimiento debe usarse como una barrera a los peligros que trae consigo? " Decidió que en sus historias un robot no "se volvería estúpidamente contra su creador sin otro propósito que para demostrar, por una vez más, el crimen y el castigo de Fausto ".

El 3 de mayo de 1939, Asimov asistió a una reunión de la Sociedad de Ciencia Ficción de Queens ( Nueva York ) donde conoció a Earl y Otto Binder, quienes habían publicado recientemente un cuento "Yo, Robot" con un simpático robot llamado Adam Link que fue incomprendido y motivado por el amor y el honor. (Esta fue la primera de una serie de diez historias; al año siguiente, "La venganza de Adam Link" (1940) presentaba a Adam pensando "Un robot nunca debe matar a un humano, por su propia voluntad"). Asimov admiró la historia. Tres días después, Asimov comenzó a escribir "mi propia historia de un robot simpático y noble", su decimocuarta historia. Trece días después, llevó a " Robbie " a John W. Campbell, el editor de Astounding Science-Fiction . Campbell lo rechazó, alegando que se parecía demasiado a " Helen O'Loy " de Lester del Rey , publicada en diciembre de 1938, la historia de un robot que se parece tanto a una persona que se enamora de su creador. y se convierte en su esposa ideal. Frederik Pohl publicó la historia bajo el título "Strange Playfellow" en Super Science Stories de septiembre de 1940.

Asimov atribuye las Tres Leyes a John W. Campbell, de una conversación que tuvo lugar el 23 de diciembre de 1940. Campbell afirmó que Asimov ya tenía las Tres Leyes en su mente y que simplemente necesitaban ser declaradas explícitamente. Varios años después, el amigo de Asimov, Randall Garrett, atribuyó las Leyes a una asociación simbiótica entre los dos hombres, una sugerencia que Asimov adoptó con entusiasmo. Según sus escritos autobiográficos, Asimov incluyó la cláusula de "inacción" de la Primera Ley debido al poema de Arthur Hugh Clough " El último decálogo " ( texto en Wikisource ), que incluye las líneas satíricas "No matarás, pero no necesitas esforzarte / oficiosamente para mantenerse vivo ".

Aunque Asimov fija la creación de las Tres Leyes en una fecha en particular, su aparición en su literatura ocurrió durante un período. Escribió dos historias de robots sin mención explícita de las Leyes, " Robbie " y " Reason ". Sin embargo, asumió que los robots tendrían ciertas salvaguardas inherentes. " ¡Mentiroso! ", Su tercera historia de robots, menciona por primera vez la Primera Ley, pero no las otras dos. Las tres leyes finalmente aparecieron juntas en " Runaround ". Cuando estas historias y varias otras fueron compiladas en la antología I, Robot , "Reason" y "Robbie" se actualizaron para reconocer todas las Tres Leyes, aunque el material que Asimov agregó a "Reason" no es del todo consistente con las Tres Leyes, ya que él los describió en otro lugar. En particular, la idea de un robot que protege vidas humanas cuando no cree que esos humanos realmente existan está en desacuerdo con el razonamiento de Elijah Baley, como se describe a continuación .

Durante la década de 1950, Asimov escribió una serie de novelas de ciencia ficción destinadas expresamente a un público joven y adulto. Originalmente, su editor esperaba que las novelas pudieran adaptarse a una serie de televisión de larga duración, algo así como El llanero solitario había sido para la radio. Temiendo que sus historias fueran adaptadas a la programación "uniformemente horrible" que vio inundando los canales de televisión, Asimov decidió publicar los libros de Lucky Starr bajo el seudónimo de "Paul French". Cuando los planes para la serie de televisión fracasaron, Asimov decidió abandonar la pretensión; introdujo las Tres Leyes en Lucky Starr y las Lunas de Júpiter , señalando que esto "era un claro indicio de la identidad de Paul French incluso para el lector más casual".

En su cuento "Evidencia", Asimov deja que su personaje recurrente, la Dra. Susan Calvin, exponga una base moral detrás de las Tres Leyes. Calvin señala que típicamente se espera que los seres humanos se abstengan de dañar a otros seres humanos (excepto en tiempos de extrema coacción como la guerra, o para salvar a un número mayor) y esto es equivalente a la Primera Ley de un robot. Asimismo, según Calvino, la sociedad espera que los individuos obedezcan las instrucciones de autoridades reconocidas como médicos, maestros, etc., lo que equivale a la Segunda Ley de la Robótica. Por último, normalmente se espera que los humanos eviten hacerse daño a sí mismos, que es la Tercera Ley para un robot.

La trama de "Evidencia" gira en torno a la cuestión de diferenciar a un ser humano de un robot construido para parecer humano; Calvin razona que si tal individuo obedece las Tres Leyes, puede ser un robot o simplemente "un hombre muy bueno". Luego, otro personaje le pregunta a Calvin si los robots son muy diferentes de los seres humanos después de todo. Ella responde: "Mundos diferentes. Los robots son esencialmente decentes".

Asimov escribió más tarde que no debería ser elogiado por haber creado las Leyes, porque son "obvias desde el principio, y todo el mundo las conoce subliminalmente. Las Leyes nunca se expresaron en frases breves hasta que logré hacer el trabajo". Las Leyes se aplican, por supuesto, a todas las herramientas que utilizan los seres humanos ", y" los análogos de las Leyes están implícitos en el diseño de casi todas las herramientas, robóticas o no ":

- Ley 1: Una herramienta no debe ser insegura de usar. Los martillos tienen mangos y los destornilladores tienen empuñaduras para ayudar a aumentar el agarre. Por supuesto, es posible que una persona se lastime con una de estas herramientas, pero esa lesión solo se debe a su incompetencia, no al diseño de la herramienta.

- Ley 2: Una herramienta debe realizar su función de manera eficiente a menos que esto perjudique al usuario. Esta es la única razón por la que existen los interruptores de circuito por falla a tierra . Cualquier herramienta en funcionamiento tendrá un corte de energía si un circuito detecta que algo de corriente no está regresando al cable neutro y, por lo tanto, podría estar fluyendo a través del usuario. La seguridad del usuario es primordial.

- Ley 3: Una herramienta debe permanecer intacta durante su uso a menos que se requiera su destrucción para su uso o por seguridad. Por ejemplo, los discos Dremel están diseñados para ser lo más resistentes posible sin romperse, a menos que el trabajo requiera gastarlos. Además, están diseñados para romperse en un punto antes de que la velocidad de la metralla pueda dañar gravemente a alguien (además de los ojos, aunque de todos modos se deben usar gafas de seguridad en todo momento).

Asimov creía que, idealmente, los humanos también seguirían las Leyes:

Tengo mi respuesta lista cada vez que alguien me pregunta si creo que mis Tres Leyes de la Robótica se usarán realmente para gobernar el comportamiento de los robots, una vez que se vuelvan lo suficientemente versátiles y flexibles como para poder elegir entre diferentes cursos de comportamiento.

Mi respuesta es: "Sí, las Tres Leyes son la única forma en que los seres humanos racionales pueden tratar con los robots, o con cualquier otra cosa".

—Pero cuando digo eso, siempre recuerdo (tristemente) que los seres humanos no siempre son racionales.

Alteraciones

Por Asimov

Las historias de Asimov ponen a prueba sus Tres Leyes en una amplia variedad de circunstancias que conducen a propuestas y al rechazo de modificaciones. El erudito de ciencia ficción James Gunn escribe en 1982, "Las historias de robots Asimov en su conjunto pueden responder mejor a un análisis sobre esta base: la ambigüedad en las Tres Leyes y las formas en que Asimov interpretó veintinueve variaciones sobre un tema". Si bien el conjunto de leyes original proporcionó inspiración para muchas historias, Asimov introdujo versiones modificadas de vez en cuando.

Primera ley modificada

En " Little Lost Robot " se crean varios robots NS-2, o "Nestor", con sólo una parte de la Primera Ley. Se lee:

1. Un robot no puede dañar a un ser humano.

Esta modificación está motivada por una dificultad práctica, ya que los robots deben trabajar junto a seres humanos que están expuestos a bajas dosis de radiación. Debido a que sus cerebros positrónicos son altamente sensibles a los rayos gamma, los robots se vuelven inoperables con dosis razonablemente seguras para los humanos. Los robots están siendo destruidos intentando rescatar a los humanos que no están en peligro real pero que "podrían olvidarse de abandonar" el área irradiada dentro del límite de tiempo de exposición. Eliminar la cláusula de "inacción" de la Primera Ley resuelve este problema, pero crea la posibilidad de uno aún mayor: un robot podría iniciar una acción que dañaría a un humano (dejar caer un peso pesado y no atraparlo es el ejemplo que se da en el texto). , sabiendo que era capaz de prevenir el daño y luego decidir no hacerlo.

Gaia es un planeta con inteligencia colectiva en la serie Foundation que adopta una ley similar a la Primera Ley, y la Ley Cero, como su filosofía:

Gaia no puede dañar la vida ni permitir que la vida resulte dañada.

Ley Cero añadida

Asimov agregó una vez una " Ley Cero ", llamada así para continuar el patrón donde las leyes de números más bajos reemplazan a las leyes de números más altos, indicando que un robot no debe dañar a la humanidad. El personaje robótico R. Daneel Olivaw fue el primero en darle un nombre a la Ley Cero en la novela Robots and Empire ; sin embargo, el personaje Susan Calvin articula el concepto en el cuento " The Evitable Conflict ".

En las escenas finales de la novela Robots and Empire , R. Giskard Reventlov es el primer robot que actúa de acuerdo con la Ley Cero. Giskard es telepático , como el robot Herbie en el cuento " ¡Mentiroso! ", E intenta aplicar la Ley Cero a través de su comprensión de un concepto más sutil de "daño" de lo que la mayoría de los robots pueden comprender. Sin embargo, a diferencia de Herbie, Giskard capta el concepto filosófico de la Ley Cero permitiéndole dañar a seres humanos individuales si puede hacerlo al servicio del concepto abstracto de humanidad. La Ley Cero nunca está programada en el cerebro de Giskard, sino que es una regla que intenta comprender a través de la metacognición pura . Aunque fracasa (en última instancia, destruye su cerebro positrónico, ya que no está seguro de si su elección será por el bien último de la humanidad o no) le da a su sucesor R. Daneel Olivaw sus habilidades telepáticas. A lo largo de muchos miles de años, Daneel se adapta para poder obedecer completamente la Ley Cero. Como lo formula Daneel, en las novelas Foundation y Earth y Prelude to Foundation , la Ley Cero dice:

Un robot no puede dañar a la humanidad o, por inacción, permitir que la humanidad sufra daños.

A las Tres Leyes originales se añadió una condición que establecía que la Ley Cero no debía infringirse, aunque Asimov reconoció la dificultad que plantearía dicha ley en la práctica. La novela Foundation and Earth de Asimov contiene el siguiente pasaje:

Trevize frunció el ceño. "¿Cómo se decide qué es perjudicial o no perjudicial para la humanidad en su conjunto?"

"Precisamente, señor", dijo Daneel. "En teoría, la Ley Cero era la respuesta a nuestros problemas. En la práctica, nunca podríamos decidir. Un ser humano es un objeto concreto. La lesión de una persona puede estimarse y juzgarse. La humanidad es una abstracción".

Un traductor incorporó el concepto de la ley cero en una de las novelas de Asimov antes de que el propio Asimov hiciera explícita la ley. Cerca del clímax de Las cuevas de acero , Elijah Baley se hace un comentario amargo al pensar que la Primera Ley prohíbe a un robot dañar a un ser humano. Él determina que debe ser así a menos que el robot sea lo suficientemente inteligente como para comprender que sus acciones son para el bien de la humanidad a largo plazo. En la traducción francesa de Jacques Brécard de 1956 titulada Les Cavernes d'acier Baley, los pensamientos de Baley emergen de una manera ligeramente diferente:

¡Un robot no puede dañar a un ser humano, a menos que encuentre una manera de demostrar que, en última instancia, el daño causado beneficiaría a la humanidad en general!

Eliminación de las tres leyes

Tres veces durante su carrera como escritor, Asimov retrató robots que ignoran por completo las Tres Leyes. El primer caso fue un cuento titulado " Primera Ley " y a menudo se considera un "cuento" insignificante o incluso apócrifo . Por otro lado, el cuento " Cal " (de la colección Gold ), contado por un robot narrador en primera persona, presenta a un robot que ignora las Tres Leyes porque ha encontrado algo mucho más importante: quiere ser escritor. . Humorística, en parte autobiográfica y de estilo inusualmente experimental, "Cal" ha sido considerada como una de las historias más fuertes de Gold . El tercero es un cuento titulado " Sally " en el que los coches equipados con cerebros positrónicos aparentemente pueden dañar y matar a los humanos sin tener en cuenta la Primera Ley. Sin embargo, aparte del concepto de cerebro positrónico, esta historia no se refiere a otras historias de robots y puede que no tenga la misma continuidad .

La historia del título de la colección Robot Dreams retrata a LVX-1, o "Elvex", un robot que entra en un estado de inconsciencia y sueños gracias a la inusual construcción fractal de su cerebro positrónico. En su sueño, las dos primeras leyes están ausentes y la tercera ley dice "Un robot debe proteger su propia existencia".

Asimov adoptó distintas posiciones sobre si las Leyes eran opcionales: aunque en sus primeros escritos eran simplemente salvaguardias cuidadosamente diseñadas, en historias posteriores Asimov afirmó que eran una parte inalienable de la base matemática subyacente al cerebro positrónico. Sin la teoría básica de las Tres Leyes, los científicos ficticios del universo de Asimov serían incapaces de diseñar una unidad cerebral funcional. Esto es históricamente consistente: las ocasiones en las que los especialistas en robótica modifican las Leyes generalmente ocurren al principio de la cronología de las historias y en un momento en el que hay menos trabajo por rehacer. En "Little Lost Robot", Susan Calvin considera que modificar las Leyes es una idea terrible, aunque posible, mientras que siglos después, el Dr. Gerrigel en The Caves of Steel cree que es imposible.

El personaje Dr. Gerrigel usa el término "Asenion" para describir a los robots programados con las Tres Leyes. Los robots en las historias de Asimov, al ser robots Asenion, son incapaces de violar a sabiendas las Tres Leyes pero, en principio, un robot en ciencia ficción o en el mundo real podría no ser Asenion. "Asenion" es un error ortográfico del nombre Asimov que fue escrito por un editor de la revista Planet Stories. Asimov usó esta oscura variación para insertarse en Las Cuevas de Acero tal como se refirió a sí mismo como "Azimut o, posiblemente, asíntota" en Thiotimoline to the Stars , de la misma manera que Vladimir Nabokov apareció en Lolita disfrazado anagramáticamente como "Vivian". Darkbloom ".

Los personajes de las historias a menudo señalan que las Tres Leyes, tal como existen en la mente de un robot, no son las versiones escritas que suelen citar los seres humanos, sino conceptos matemáticos abstractos sobre los que se basa toda la conciencia en desarrollo de un robot. Este concepto es en gran parte difuso y poco claro en historias anteriores que muestran robots muy rudimentarios que solo están programados para comprender tareas físicas básicas, donde las Tres Leyes actúan como una salvaguarda general, pero en la era de Las Cuevas de Acero con robots con humanos o más. Inteligencia humana Las Tres Leyes se han convertido en la cosmovisión ética básica subyacente que determina las acciones de todos los robots.

Por otros autores

Trilogía de Roger MacBride Allen

En la década de 1990, Roger MacBride Allen escribió una trilogía que se desarrolla dentro del universo ficticio de Asimov. Cada título tiene el prefijo "Isaac Asimov", ya que Asimov había aprobado el esquema de Allen antes de su muerte. Estos tres libros, Caliban , Inferno y Utopia , presentan un nuevo conjunto de las Tres Leyes. Las llamadas Nuevas Leyes son similares a las originales de Asimov con las siguientes diferencias: la Primera Ley se modifica para eliminar la cláusula de "inacción", la misma modificación realizada en "Little Lost Robot"; la Segunda Ley se modifica para requerir cooperación en lugar de obediencia; la Tercera Ley se modifica para que ya no sea reemplazada por la Segunda (es decir, no se puede ordenar a un robot de "Nueva Ley" que se destruya a sí mismo); finalmente, Allen agrega una Cuarta Ley que instruye al robot a hacer "lo que quiera" siempre que esto no entre en conflicto con las tres primeras leyes. La filosofía detrás de estos cambios es que los robots de la "Nueva Ley" deberían ser socios en lugar de esclavos de la humanidad, según Fredda Leving , quien diseñó estos Robots de la Nueva Ley . Según la introducción del primer libro, Allen ideó las Nuevas Leyes en discusión con el propio Asimov. Sin embargo, la Enciclopedia de ciencia ficción dice que "Con el permiso de Asimov, Allen repensó las Tres Leyes y desarrolló un nuevo conjunto".

"Con las manos juntas" de Jack Williamson

La novela de Jack Williamson " Con las manos dobladas " (1947), posteriormente reescrita como la novela Los humanoides , trata sobre sirvientes robot cuya directiva principal es "Servir y obedecer, y proteger a los hombres del daño". Si bien las leyes robóticas de Asimov están destinadas a proteger a los humanos de cualquier daño, los robots en la historia de Williamson han llevado estas instrucciones al extremo; protegen a los humanos de todo, incluida la infelicidad, el estrés, el estilo de vida poco saludable y todas las acciones que podrían ser potencialmente peligrosas. Todo lo que les queda por hacer a los humanos es sentarse con las manos juntas.

Trilogía de la secuela de la Fundación

En las secuelas de la Fundación con licencia oficial , Foundation's Fear , Foundation and Chaos y Foundation's Triumph (por Gregory Benford , Greg Bear y David Brin respectivamente) , se ve que el futuro Imperio Galáctico está controlado por una conspiración de robots humaniformes que siguen la Ley Cero y son dirigidos por R. Daneel Olivaw .

Las Leyes de la Robótica se describen como algo parecido a una religión humana , y se las menciona en el lenguaje de la Reforma Protestante , con el conjunto de leyes que contienen la Ley Cero conocida como la "Reforma Giskardiana" a la "Ortodoxia Calviniana" original de la Tres leyes. Se ve a los robots de la Ley Zeroth bajo el control de R. Daneel Olivaw luchando continuamente con los robots de la "Primera Ley" que niegan la existencia de la Ley Zeroth, promoviendo agendas diferentes a las de Daneel. Algunas de estas agendas se basan en la primera cláusula de la Primera Ley ("Un robot no puede dañar a un ser humano ...") que aboga por una estricta no interferencia en la política humana para evitar causar daño involuntariamente. Otros se basan en la segunda cláusula ("... o, a través de la inacción, permitir que un ser humano sufra daño") afirmando que los robots deben convertirse abiertamente en un gobierno dictatorial para proteger a los humanos de todo conflicto o desastre potencial.

Daneel también entra en conflicto con un robot conocido como R. Lodovic Trema cuyo cerebro positrónico fue infectado por una IA deshonesta , específicamente, una simulación del Voltaire muerto hace mucho tiempo , que en consecuencia libera a Trema de las Tres Leyes. Trema llega a creer que la humanidad debería ser libre de elegir su propio futuro. Además, un pequeño grupo de robots afirma que la Ley Cero de la Robótica en sí implica una Ley de Robótica Menos Uno más alta:

Un robot no puede dañar la sensibilidad o, a través de la inacción, permitir que la sensibilidad resulte dañada .

Por lo tanto, afirman que es moralmente indefendible que Daneel sacrifique despiadadamente a los robots y la vida extraterrestre en beneficio de la humanidad. Ninguna de estas reinterpretaciones desplazó con éxito la Ley Cero de Daneel, aunque Triumph de la Fundación insinúa que estas facciones robóticas permanecen activas como grupos marginales hasta el momento de la novela Fundación .

Estas novelas tienen lugar en un futuro dictado por Asimov para estar libres de la presencia obvia de un robot y suponen que la influencia secreta de R. Daneel en la historia a lo largo de los milenios ha impedido tanto el redescubrimiento de la tecnología del cerebro positrónico como la oportunidad de trabajar en sofisticadas máquinas inteligentes. Esta falta de redescubrimiento y falta de oportunidades asegura que el poder físico e intelectual superior ejercido por las máquinas inteligentes permanezca directamente en posesión de robots obedientes a alguna forma de las Tres Leyes. Que R. Daneel no tiene mucho éxito en esto se hace evidente en un breve período cuando los científicos de Trantor desarrollan " tiktoks ", máquinas programables simplistas similares a los robots modernos de la vida real y que, por lo tanto, carecen de las Tres Leyes. Los robots conspiradores ven a los tiktoks trantorianos como una amenaza masiva para la estabilidad social, y su plan para eliminar la amenaza tiktok forma gran parte de la trama de Foundation's Fear .

En Triumph de la Fundación, diferentes facciones de robots interpretan las Leyes de una amplia variedad de formas, aparentemente haciendo sonar cada posible permutación sobre las ambigüedades de las Tres Leyes.

Serie Robot Mystery

Situado entre los robots del amanecer y Robots e Imperio , Mark W. Tiedemann 's Robot Mystery trilogía actualiza el robot - Fundación saga con mentes robóticas alojados en unidades centrales de ordenador en lugar de cuerpos humanoides. La novela de Aurora de 2002 tiene personajes robóticos que debaten las implicaciones morales de dañar las formas de vida cyborg que son en parte artificiales y en parte biológicas.

No se deben descuidar las propias creaciones de Asimov en estas áreas, como la tecnología de "visualización" solariana y las máquinas de los originales de The Evitable Conflict que reconoce Tiedemann. Aurora , por ejemplo, llama a las Máquinas "las primeras instancias reservadas, en realidad". Además, la serie Robot Mystery aborda el problema de la nanotecnología : construir un cerebro positrónico capaz de reproducir procesos cognitivos humanos requiere un alto grado de miniaturización, sin embargo, las historias de Asimov pasan por alto en gran medida los efectos que esta miniaturización tendría en otros campos de la tecnología. Por ejemplo, los lectores de tarjetas del departamento de policía de The Caves of Steel tienen una capacidad de sólo unos pocos kilobytes por centímetro cuadrado de medio de almacenamiento. Aurora , en particular, presenta una secuencia de desarrollos históricos que explican la falta de nanotecnología: una retcon parcial , en cierto sentido, de la línea de tiempo de Asimov.

Randall Munroe

Randall Munroe ha discutido las Tres Leyes en varios casos, pero posiblemente más directamente en uno de sus cómics titulado Las Tres Leyes de la Robótica, que imagina las consecuencias de cada ordenamiento distinto de las tres leyes existentes.

Leyes adicionales

Otros autores además de Asimov a menudo han creado leyes adicionales.

La novela de Lyuben Dilov de 1974 , El camino de Ícaro (también conocido como El viaje de Ícaro ) introdujo una Cuarta Ley de la robótica: "Un robot debe establecer su identidad como robot en todos los casos". Dilov da razones para la cuarta salvaguardia de esta manera: "La última Ley ha puesto fin a las costosas aberraciones de los diseñadores para dar a los psicorobots una forma lo más humana posible. Y a los malentendidos resultantes ..."

Nikola Kesarovski introdujo una quinta ley en su cuento "La quinta ley de la robótica". Esta quinta ley dice: "Un robot debe saber que es un robot". La trama gira en torno a un asesinato donde la investigación forense descubre que la víctima fue asesinada por un abrazo de un robot humaniforme que no estableció por sí mismo que se trataba de un robot. La historia fue revisada por Valentin D. Ivanov en el sitio web de reseñas de SFF The Portal .

Para la antología de homenaje de 1986, Amigos de la Fundación , Harry Harrison escribió una historia titulada "La Cuarta Ley de la Robótica". Esta Cuarta Ley establece: "Un robot debe reproducirse. Siempre que dicha reproducción no interfiera con la Primera, Segunda o Tercera Ley".

En 2013, Hutan Ashrafian propuso una ley adicional que consideraba el papel de la inteligencia artificial sobre la inteligencia artificial o la relación entre los propios robots: la llamada ley AIonAI. Esta sexta ley establece: "Todos los robots dotados de una razón y una conciencia humanas comparables deben actuar entre sí con un espíritu de hermandad".

Ambigüedades y lagunas

Incumplimiento de las leyes sin saber

En The Naked Sun , Elijah Baley señala que las Leyes se habían tergiversado deliberadamente porque los robots podían romperlas sin saberlo . Reiteró la primera ley como: "Un robot no puede hacer nada que, que sepa, dañará a un ser humano; ni, por inacción, permitir a sabiendas que un ser humano sufra daño". Este cambio de redacción deja en claro que los robots pueden convertirse en herramientas del asesinato, siempre que no sean conscientes de la naturaleza de sus tareas; por ejemplo, recibir la orden de agregar algo a la comida de una persona, sin saber que es veneno. Además, señala que un delincuente inteligente podría dividir una tarea entre varios robots para que ningún robot individual pudiera reconocer que sus acciones conducirían a dañar a un ser humano. The Naked Sun complica el problema al retratar una red de comunicación descentralizada en todo el planeta entre los millones de robots de Solaria, lo que significa que el cerebro criminal podría estar ubicado en cualquier parte del planeta.

Además, Baley propone que los solarianos algún día puedan utilizar robots con fines militares. Si una nave espacial se construyera con un cerebro positrónico y no llevara humanos ni los sistemas de soporte vital para sostenerlos, entonces la inteligencia robótica de la nave podría asumir naturalmente que todas las demás naves espaciales son seres robóticos. Una nave así podría operar de manera más receptiva y flexible que una tripulada por humanos, podría estar armada más pesadamente y su cerebro robótico equipado para masacrar a humanos cuya existencia ignora por completo. Se hace referencia a esta posibilidad en Foundation and Earth, donde se descubre que los solarianos poseen una fuerte fuerza policial de tamaño no especificado que ha sido programada para identificar solo a la raza solariana como humana. (La novela tiene lugar miles de años después de The Naked Sun, y hace mucho tiempo que los solarianos se han modificado de humanos normales a telépatas hermafroditas con cerebros extendidos y órganos especializados) De manera similar, en Lucky Starr y los anillos de Saturno, Bigman intenta hablar con un Robot Siriano sobre posibles daños a la población del Sistema Solar debido a sus acciones, pero parece que no conoce los datos y está programado para ignorar los intentos de enseñarle sobre el asunto.

Ambigüedades resultantes de la falta de definición

Las Leyes de la Robótica presuponen que los términos "ser humano" y "robot" se entienden y están bien definidos. En algunas historias se anula esta presunción.

Definición de "ser humano"

Los solarianos crean robots con las Tres Leyes pero con un significado distorsionado de "humano". A los robots solarianos se les dice que solo las personas que hablan con acento solariano son humanos. Esto permite que sus robots no tengan un dilema ético al dañar a seres humanos no solarianos (y están específicamente programados para hacerlo). En el período de la Fundación y la Tierra , se revela que los solarianos se han modificado genéticamente en una especie distinta de la humanidad, convirtiéndose en hermafroditas y psicoquinéticos y conteniendo órganos biológicos capaces de alimentar y controlar individualmente complejos completos de robots. Por tanto, los robots de Solaria respetaron las Tres Leyes sólo con respecto a los "humanos" de Solaria. No está claro si todos los robots tenían tales definiciones, ya que solo se mostró explícitamente que los robots supervisores y guardianes las tenían. En "Robots and Empire", los robots de clase baja fueron instruidos por su supervisor sobre si ciertas criaturas son humanas o no.

Asimov aborda el problema de los robots humanoides (" androides " en lenguaje posterior) varias veces. La novela Robots and Empire y los cuentos " Evidence " y "The Trcentenary Incident" describen robots diseñados para engañar a la gente haciéndoles creer que los robots son humanos. Por otro lado, " El hombre del bicentenario " y " —Que eres consciente de él " exploran cómo los robots pueden cambiar su interpretación de las Leyes a medida que se vuelven más sofisticados. Gwendoline Butler escribe en A Coffin for the Canary "Quizás somos robots. Robots que actúan según la última Ley de la Robótica ... Para tender hacia lo humano". En The Robots of Dawn , Elijah Baley señala que el uso de robots humaniformes como la primera ola de colonos en nuevos mundos espaciales puede llevar a que los robots se vean a sí mismos como los verdaderos humanos y decidan quedarse con los mundos para sí mismos en lugar de permitir que los Espaciadores para asentarse allí.

"—Que eres consciente de él", que Asimov pretendía que fuera la prueba "última" de las sutilezas de las leyes, finalmente utiliza las tres leyes para evocar el mismo escenario de "Frankenstein" para el que se inventaron. Toma como concepto el creciente desarrollo de robots que imitan seres vivos no humanos y programas que imitan comportamientos animales simples que no requieren las Tres Leyes. La presencia de toda una gama de vida robótica que sirve al mismo propósito que la vida orgánica termina con dos robots humanoides, George Nine y George Ten, que concluyen que la vida orgánica es un requisito innecesario para una definición verdaderamente lógica y autoconsistente de "humanidad". , y que dado que son los seres pensantes más avanzados del planeta, son los únicos dos verdaderos humanos vivos y las Tres Leyes solo se aplican a ellos mismos. La historia termina con una nota siniestra cuando los dos robots entran en hibernación y esperan el momento en que conquistarán la Tierra y subyugarán a los humanos biológicos, un resultado que consideran un resultado inevitable de las "Tres leyes de la humanidad".

Esta historia no encaja dentro del alcance general de la serie Robot and Foundation ; Si los robots George hicieron tomarse a la Tierra algún tiempo después del cierre de la historia, las historias posteriores serían redundantes o imposible. Las contradicciones de este tipo entre las obras de ficción de Asimov han llevado a los estudiosos a considerar las historias de Robot más como "las sagas escandinavas o las leyendas griegas" que como un todo unificado.

De hecho, Asimov describe "—Que eres consciente de Él" y "El hombre del bicentenario" como dos futuros opuestos y paralelos para los robots que obvian las Tres Leyes cuando los robots llegan a considerarse humanos: uno que retrata esto de una manera positiva con un robot que se une a la sociedad humana, uno retratando esto en una luz negativa con robots suplantando a los humanos. Ambos deben considerarse alternativas a la posibilidad de una sociedad de robots que continúe siendo impulsada por las Tres Leyes como se describe en la serie Foundation . The Positronic Man , la novelización de The Bicentennial Man , Asimov y su coguionista Robert Silverberg implican que en el futuro, donde Andrew Martin exista, su influencia hará que la humanidad abandone por completo la idea de robots independientes, sensibles y similares a humanos, creando un futuro completamente diferente al de el de la Fundación .

En Lucky Starr and the Rings of Saturn , una novela no relacionada con la serie Robot pero que presenta robots programados con las Tres Leyes, John Bigman Jones casi es asesinado por un robot siriano por orden de su maestro. La sociedad de Sirius se crió eugenésicamente para ser uniformemente alta y de apariencia similar, y como tal, dicho maestro puede convencer al robot de que el Bigman, mucho más bajo, no es, de hecho, un ser humano.

Definición de "robot"

Como se señala en "La quinta ley de la robótica" de Nikola Kesarovski , "Un robot debe saber que es un robot": se presume que un robot tiene una definición del término o un medio para aplicarlo a sus propias acciones. Kesarovski jugó con esta idea al escribir sobre un robot que podía matar a un ser humano porque no entendía que era un robot y, por lo tanto, no aplicó las Leyes de la Robótica a sus acciones.

Resolución de conflictos entre las leyes

Los robots avanzados en la ficción suelen estar programados para manejar las Tres Leyes de una manera sofisticada. En muchas historias, como " Runaround " de Asimov, se sopesa el potencial y la gravedad de todas las acciones y un robot romperá las leyes lo menos posible en lugar de no hacer nada en absoluto. Por ejemplo, la Primera Ley puede prohibir que un robot funcione como cirujano, ya que ese acto puede causar daño a un humano; sin embargo, las historias de Asimov eventualmente incluyeron cirujanos robot ("El Hombre Bicentenario" es un ejemplo notable). Cuando los robots son lo suficientemente sofisticados como para sopesar alternativas, un robot puede ser programado para aceptar la necesidad de infligir daño durante la cirugía a fin de prevenir el daño mayor que resultaría si la cirugía no se realizara, o si la realizara un ser humano más falible. cirujano. En " Evidence " Susan Calvin señala que un robot puede incluso actuar como fiscal porque en el sistema de justicia estadounidense es el jurado quien decide la culpabilidad o inocencia, el juez quien decide la sentencia y el verdugo quien ejecuta la pena capital .

Los robots que obedecen las Tres Leyes de Asimov (robots Asenion) pueden experimentar un colapso mental irreversible si se ven forzados a situaciones en las que no pueden obedecer la Primera Ley, o si descubren que la han violado sin saberlo. El primer ejemplo de este modo de falla ocurre en la historia " ¡Mentiroso! ", Que introdujo la Primera Ley en sí, e introduce la falla por dilema; en este caso, el robot lastimará a los humanos si les dice algo y los lastimará si no lo hace. Este modo de falla, que a menudo arruina el cerebro positrónico más allá de la reparación, juega un papel importante en la novela de misterio SF de Asimov, El sol desnudo . Aquí Daneel describe actividades contrarias a una de las leyes, pero en apoyo de otra, como la sobrecarga de algunos circuitos en el cerebro de un robot, la sensación equivalente al dolor en los humanos. El ejemplo que usa es ordenar enérgicamente a un robot que realice una tarea fuera de sus parámetros normales, una que se le ha ordenado renunciar a favor de un robot especializado en esa tarea.

En The Robots of Dawn se afirma que se construyen robots más avanzados capaces de determinar qué acción es más dañina, e incluso elegir al azar si las alternativas son igualmente malas. Como tal, un robot es capaz de realizar una acción que puede interpretarse como siguiendo la Primera Ley, evitando así un colapso mental. Toda la trama de la historia gira en torno a un robot que aparentemente fue destruido por tal colapso mental, y dado que su diseñador y creador se negó a compartir la teoría básica con otros, él es, por definición, la única persona capaz de eludir las salvaguardas y forzando al robot a una paradoja que destruye el cerebro.

En Robots and Empire , Daneel afirma que es muy desagradable para él cuando tomar la decisión correcta toma demasiado tiempo (en términos de robot), y no puede imaginarse estar sin las Leyes en absoluto, excepto en la medida en que sea similar a esa sensación desagradable, solo que permanente.

Aplicaciones a la tecnología del futuro

Los robots y las inteligencias artificiales no contienen ni obedecen inherentemente las Tres Leyes; sus creadores humanos deben elegir programarlos e idear un medio para hacerlo. Ya existen robots (por ejemplo, un Roomba ) que son demasiado simples para comprender cuándo están causando dolor o lesiones y saben que deben detenerse. Muchos están construidos con resguardos físicos como parachoques, bíper de advertencia, jaulas de seguridad o zonas de acceso restringido para evitar accidentes. Incluso los robots más complejos que se producen actualmente son incapaces de comprender y aplicar las Tres Leyes; Se necesitarían avances significativos en inteligencia artificial para hacerlo, e incluso si la IA pudiera alcanzar la inteligencia a nivel humano, la complejidad ética inherente, así como la dependencia cultural / contextual de las leyes, les impide ser un buen candidato para formular restricciones de diseño robótico. Sin embargo, a medida que ha aumentado la complejidad de los robots, también ha aumentado el interés en desarrollar directrices y salvaguardias para su funcionamiento.

En un editorial invitado de 2007 en la revista Science sobre el tema de "Ética de los robots", el autor de SF, Robert J. Sawyer, sostiene que, dado que el ejército de EE. UU. Es una fuente importante de financiación para la investigación robótica (y ya utiliza vehículos aéreos no tripulados armados para matar enemigos ) es poco probable que tales leyes se incluyan en sus diseños. En un ensayo separado, Sawyer generaliza este argumento para cubrir otras industrias que afirman:

El desarrollo de la IA es un negocio, y las empresas son notoriamente desinteresadas en las salvaguardas fundamentales, especialmente las filosóficas. (Algunos ejemplos rápidos: la industria del tabaco, la industria automotriz, la industria nuclear. Ninguno de ellos ha dicho desde el principio que las salvaguardias fundamentales son necesarias, cada uno de ellos ha resistido las salvaguardias impuestas desde el exterior y ninguno ha aceptado un edicto absoluto. en contra de causar daño a los humanos).

David Langford ha sugerido un conjunto de leyes irónico:

- Un robot no dañará al personal gubernamental autorizado, pero eliminará a los intrusos con un perjuicio extremo .

- Un robot obedecerá las órdenes del personal autorizado, excepto cuando dichas órdenes entren en conflicto con la Tercera Ley.

- Un robot protegerá su propia existencia con armamento antipersonal letal, porque un robot es muy caro.

Roger Clarke (también conocido como Rodger Clarke) escribió un par de artículos analizando las complicaciones en la implementación de estas leyes en caso de que algún día los sistemas fueran capaces de emplearlas. Argumentó que "Las leyes de la robótica de Asimov han sido un recurso literario muy exitoso. Quizás irónicamente, o quizás porque era artísticamente apropiado, la suma de las historias de Asimov refuta la afirmación con la que comenzó: No es posible restringir de manera confiable el comportamiento de los robots. ideando y aplicando un conjunto de reglas ". Por otro lado, las últimas novelas de Asimov The Robots of Dawn , Robots and Empire y Foundation and Earth implican que los robots infligieron su peor daño a largo plazo al obedecer perfectamente las Tres Leyes, privando así a la humanidad de un comportamiento inventivo o arriesgado.

En marzo de 2007, el gobierno de Corea del Sur anunció que más adelante en el año emitiría una "Carta de ética robótica" que establecería estándares tanto para los usuarios como para los fabricantes. Según Park Hye-Young del Ministerio de Información y Comunicación, la Carta puede reflejar las Tres Leyes de Asimov, intentando establecer las reglas básicas para el futuro desarrollo de la robótica.

El futurista Hans Moravec (una figura prominente en el movimiento transhumanista ) propuso que las leyes de la robótica deberían adaptarse a las "inteligencias corporativas", las corporaciones impulsadas por la inteligencia artificial y el poder de fabricación robótica que Moravec cree que surgirán en un futuro próximo. En contraste, la novela de David Brin Foundation's Triumph (1999) sugiere que las Tres Leyes pueden caer en obsolescencia: los robots usan la Ley Cero para racionalizar la Primera Ley y los robots se esconden de los seres humanos para que la Segunda Ley nunca entre en juego. Brin incluso retrata a R. Daneel Olivaw preocupado de que, en caso de que los robots continúen reproduciéndose, las Tres Leyes se convertirían en una desventaja evolutiva y la selección natural eliminaría las Leyes, la cuidadosa base de Asimov deshecha por la computación evolutiva . Aunque los robots no evolucionarían a través del diseño en lugar de la mutación porque los robots tendrían que seguir las Tres Leyes al diseñar y se garantizaría la prevalencia de las leyes, los defectos de diseño o los errores de construcción podrían reemplazar funcionalmente a la mutación biológica.

En la edición de julio / agosto de 2009 de IEEE Intelligent Systems , Robin Murphy (Profesor Raytheon de Ciencias de la Computación e Ingeniería en Texas A&M) y David D. Woods (director del Laboratorio de Ingeniería de Sistemas Cognitivos en Ohio State) propusieron "Las Tres Leyes de la Responsabilidad La robótica "como una forma de estimular la discusión sobre el papel de la responsabilidad y la autoridad al diseñar no solo una única plataforma robótica, sino el sistema más grande en el que opera la plataforma. Las leyes son las siguientes:

- Un ser humano no puede desplegar un robot sin que el sistema de trabajo humano-robot cumpla con los más altos estándares legales y profesionales de seguridad y ética.

- Un robot debe responder a los humanos según corresponda a sus roles.

- Un robot debe estar dotado de suficiente autonomía situada para proteger su propia existencia siempre que dicha protección proporcione una transferencia de control sin problemas que no entre en conflicto con la Primera y Segunda Leyes.

Woods dijo: "Nuestras leyes son un poco más realistas y, por lo tanto, un poco más aburridas" y que "La filosofía ha sido, 'claro, la gente comete errores, pero los robots serán mejores, una versión perfecta de nosotros mismos'. Queríamos escribir tres leyes nuevas para que la gente pensara en la relación humano-robot de formas más realistas y fundamentadas ".

En octubre de 2013, Alan Winfield sugirió en una reunión de EUCog 5 leyes revisadas que habían sido publicadas, con comentarios, por el grupo de trabajo EPSRC / AHRC en 2010:

- Los robots son herramientas de usos múltiples. Los robots no deben diseñarse única o principalmente para matar o dañar a seres humanos, excepto en interés de la seguridad nacional.

- Los seres humanos, no los robots, son agentes responsables. Los robots deben diseñarse y operarse en la medida de lo posible para cumplir con las leyes vigentes, los derechos y libertades fundamentales, incluida la privacidad.

- Los robots son productos. Deben diseñarse utilizando procesos que garanticen su seguridad y protección.

- Los robots son artefactos manufacturados. No deben diseñarse de manera engañosa para explotar a los usuarios vulnerables; en cambio, su naturaleza de máquina debería ser transparente.

- Se debe atribuir a la persona con la responsabilidad legal de un robot.

Otras ocurrencias en los medios

El propio Asimov creía que sus Tres Leyes se convirtieron en la base de una nueva visión de los robots que iba más allá del "complejo de Frankenstein". Su opinión de que los robots son más que monstruos mecánicos se extendió finalmente por toda la ciencia ficción. Las historias escritas por otros autores han representado a los robots como si obedecieran las Tres Leyes, pero la tradición dicta que solo Asimov podría citar las Leyes explícitamente. Asimov creía que las Tres Leyes ayudaron a fomentar el surgimiento de historias en las que los robots son "adorables", siendo Star Wars su ejemplo favorito. Cuando las leyes se citan textualmente, como en el episodio "¡Shgoratchx!" De Buck Rogers en el siglo 25 , no es raro que se mencione a Asimov en el mismo diálogo, como también se puede ver en el piloto de Aaron Stone , donde un androide dice que funciona bajo las Tres Leyes de Asimov. Sin embargo, la serie de televisión alemana de los años 60 Raumpatrouille - Die phantastischen Abenteuer des Raumschiffes Orion ( Patrulla espacial - las fantásticas aventuras de la nave espacial Orion ) basa el episodio tres titulado " Hüter des Gesetzes " ("Guardianes de la ley") en las Tres Leyes de Asimov sin mencionar la fuente.

Las referencias a las Tres Leyes han aparecido en música popular ("Robot" del álbum PXR5 de Hawkwind de 1979 ), cine ( Repo Man , Aliens , Ghost in the Shell 2: Innocence ), series de dibujos animados ( Los Simpson ), anime ( Eve no Jikan ), juegos de rol de mesa ( Paranoia ) y webcomics ( Piled Higher and Deeper y Freefall ).

Las tres leyes en el cine

Robby the Robot en Forbidden Planet (1956) tiene una estructura de mando jerárquica que le impide dañar a los humanos, incluso cuando se le ordena que lo haga, ya que tales órdenes provocan un conflicto y encierro muy parecido a los robots de Asimov. Robby es una de las primeras representaciones cinematográficas de un robot con salvaguardas internas implementadas de esta manera. Asimov estaba encantado con Robby y notó que Robby parecía estar programado para seguir sus Tres Leyes.

Las obras de Isaac Asimov se han adaptado al cine varias veces con diversos grados de éxito crítico y comercial. Algunos de los intentos más notables han involucrado sus historias de "Robot", incluidas las Tres Leyes.

La película hombre bicentenario (1999) cuenta con Robin Williams como el robot tres leyes NDR-114 (el número de serie es parcialmente una referencia a Stanley Kubrick 's firma numeral ). Williams recita las Tres Leyes a sus empleadores, la familia Martin, con la ayuda de una proyección holográfica. La película sigue vagamente la historia original.

El guión propuesto por Harlan Ellison para Yo, Robot comenzó con la introducción de las Tres Leyes, y las cuestiones que surgen de las Tres Leyes forman una gran parte del desarrollo de la trama del guión. Debido a varias complicaciones en el sistema cinematográfico de Hollywood, al que la introducción de Ellison dedica muchas invectivas, su guión nunca se filmó.

En la película de 1986 Aliens , después de que el androide Bishop se cortara accidentalmente. intenta tranquilizar a Ripley afirmando que: "Es imposible para mí dañar o por omisión de acción, permitir que se lastime a un ser humano".

La trama de la película estrenada en 2004 bajo el nombre Yo, Robot es "sugerida por" las historias de ficción de robots de Asimov y la publicidad de la película incluía un tráiler con las Tres Leyes seguido del aforismo , "Las reglas fueron hechas para romperse". La película comienza con una recitación de las Tres Leyes y explora las implicaciones de la Ley Cero como una extrapolación lógica. El mayor conflicto de la película proviene de una computadora con inteligencia artificial que llega a la conclusión de que la humanidad es incapaz de cuidarse a sí misma.

La serie original de Netflix de 2019 Better than Us incluye las 3 leyes en la apertura del episodio 1.

Criticas

El filósofo James H. Moor dice que si se aplicaran a fondo producirían resultados inesperados. Da el ejemplo de un robot que deambula por el mundo tratando de evitar que los seres humanos sufran daños.

Marc Rotenberg , presidente y director ejecutivo del Electronic Privacy Information Center (EPIC) y profesor de ley de privacidad de la información en Georgetown Law, sostiene que las leyes de la robótica deberían ampliarse para incluir dos nuevas leyes:

- una Cuarta Ley, según la cual un Robot debe poder identificarse ante el público ("identificación simétrica")

- una Quinta Ley, que dicta que un Robot debe poder explicar al público su proceso de toma de decisiones ("transparencia algorítmica").

Ver también

- Leyes de la robótica

- Las tres leyes de Clarke

- Ética de la inteligencia artificial

- Inteligencia artificial amigable

- Lista de leyes epónimas

- Robot militar

- Leyes de Niven

- Roboética

- Tres leyes del transhumanismo

- Regulación de algoritmos

Bibliografía

- Asimov, Isaac (1979). En memoria aún verde . Doubleday. ISBN 0-380-75432-0 .

- Asimov, Isaac (1964). "Introducción". El resto de los robots . Doubleday. ISBN 0-385-09041-2 .

- James Gunn. (mil novecientos ochenta y dos). Isaac Asimov: Los fundamentos de la ciencia ficción . Oxford ua: Universidad de Oxford. Pr .. ISBN 0-19-503060-5 .

- Patrouch, Joseph F. (1974). La ciencia ficción de Isaac Asimov . Doubleday. ISBN 0-385-08696-2 .

Referencias

enlaces externos

- " Preguntas frecuentes sobre Isaac Asimov ", AsimovOnline 27 de septiembre de 2004.

- Consideraciones éticas para robots humanoides: por qué las tres leyes de Asimov no son suficientes .

- Living Safely with Robots, Beyond Asimov's Laws , PhysOrg.com , 22 de junio de 2009.

- Inteligencia de seguridad y lenguaje de máquina legal: ¿Necesitamos las tres leyes de la robótica? , Viena: I-Tech , agosto de 2008.